OpenClaw + Ollama 로컬 설정 가이드 (2026)

Claw

OpenClaw(구 Clawdbot / Moltbot)는 Telegram이나 WhatsApp 같은 메시징 앱을 연결하여 스마트폰에서 직접 로컬 대형 언어 모델(LLM)을 호출해 작업(코딩, 컴퓨터 제어, 파일 검색 등)을 수행할 수 있게 해주는 강력한 로컬 AI 에이전트 프레임워크입니다.

이를 Ollama와 결합하면 완전히 오프라인으로, 무료로, 그리고 API 비용 없이 환경을 구축할 수 있습니다.

두 가지 권장 설치 방법

방법 1: 가장 쉬운 방법 (공식 권장)

적용 대상: Mac, Linux, Windows (WSL)

-

Ollama 설치 (아직 설치하지 않은 경우)

- 공식 사이트:

- 다운로드 및 설치 후 터미널에서 다음을 실행합니다(128k+ 컨텍스트 모델 권장):

-

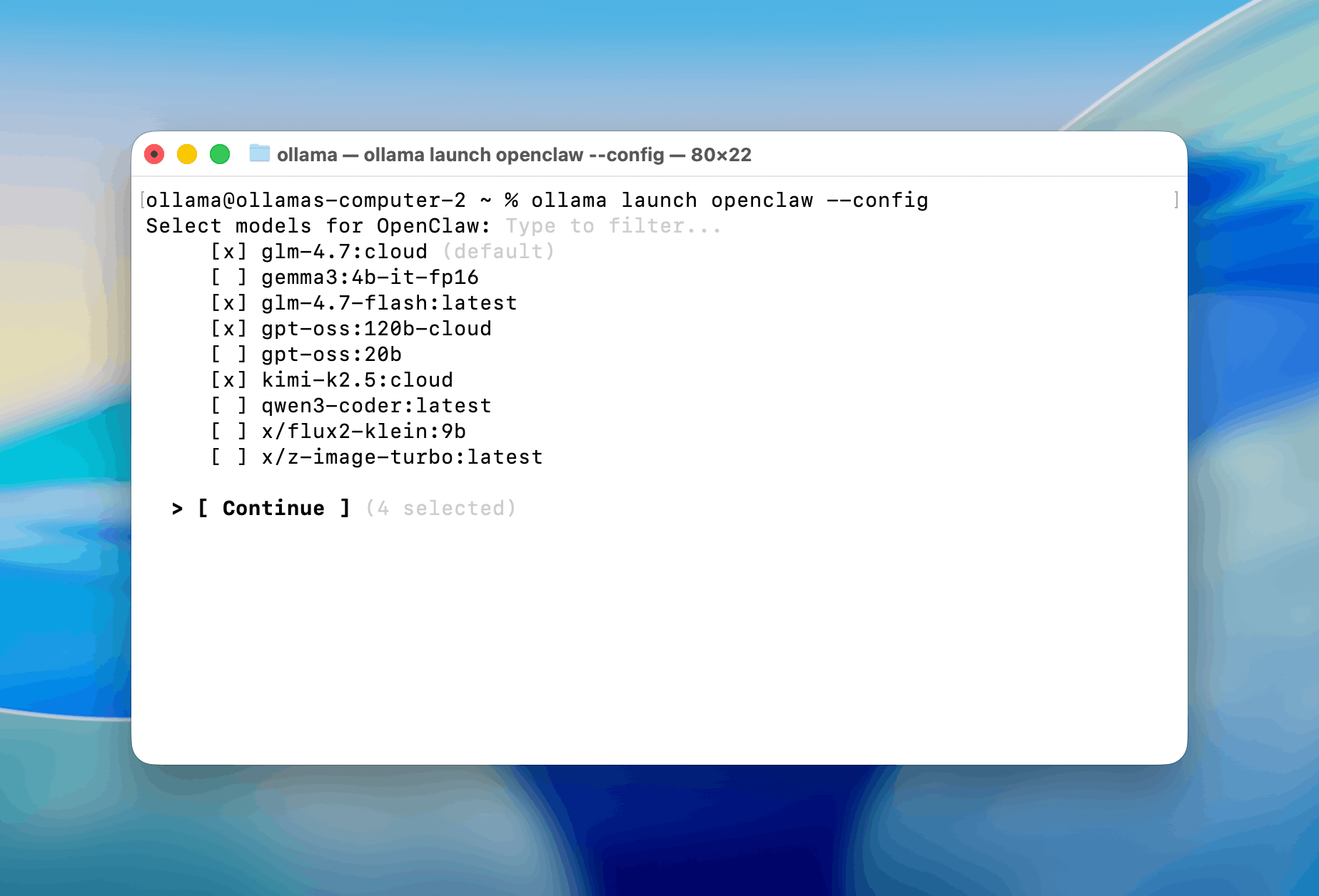

ollama launch로 OpenClaw 직접 실행이 명령어는 다음 작업을 수행합니다:

- 최신 OpenClaw 자동 설치

- 온보딩 마법사 시작

- 백엔드로 Ollama를 자동 선택

- 모델 선택 (방금 다운로드한 모델)

- Telegram / WhatsApp 채널 구성 (처음에는 건너뛸 수 있음)

완료되면 백그라운드에서 자동으로 게이트웨이가 실행됩니다(기본 기본 포트 18789).

-

Telegram을 통한 사용 시작

- 온보딩 중에 Telegram을 선택했다면, 안내에 따라 봇을 생성하고 토큰을 붙여넣으세요. 이제 귀하의 봇이 준비되었습니다!

방법 2: 수동 설치 (고급 제어용)

-

Node.js 설치 (v22 이상 권장)

-

원클릭 OpenClaw 설치

Mac/Linux:

Windows (PowerShell):

-

온보딩 실행

-

Ollama 백엔드 구성

- 마법사에서 Quick Start -> Skip Cloud -> Ollama를 선택합니다.

- 또는 설정 파일(

~/.openclaw/openclaw.json)을 수동으로 편집합니다:

-

OpenClaw 시작

문제 해결 (FAQ)

-

모델에 도구 호출(Tool Calling) 능력이 없나요?

- 함수 호출을 잘 지원하는 모델로 변경하세요. 예:

qwen2.5-coder,qwen3,deepseek-r1,llama3.3. - 최소 14B 이상의 모델을 권장합니다. 8B 모델은 도구 호출 시 환각(hallucinate) 현상을 보이거나 컨텍스트를 잊어버릴 수 있습니다.

- 함수 호출을 잘 지원하는 모델로 변경하세요. 예:

-

너무 속도가 느린가요?

- 더 작은 모델(예:

qwen2.5-coder:14b또는32b)을 시도하세요. - 또는 RunPod이나 Vast.ai에서 GPU 인스턴스를 대여하여 Ollama를 실행하세요.

- 더 작은 모델(예:

-

한국어/중국어에 가장 적합한 모델은?

- 현재(2026년 2월) 권장 사항:

qwen3 시리즈>deepseek-r1>llama3.3.

- 현재(2026년 2월) 권장 사항:

-

Telegram에서 응답이 없나요?

- OpenClaw가 실행 중인지 확인하세요(터미널 로그 확인).

- Ollama가 실행 중인지 확인하세요(

ollama ps). ollama launch openclaw를 다시 실행하여 재구성하세요.

기본적으로 현재로서는 ollama launch openclaw가 가장 번거롭지 않은 방법입니다. 대부분의 사람들이 5~10분 안에 설정하고 실행할 수 있습니다.