OpenClaw + Ollama 本地部署最简单安装教程(2026年最新方式)

Claw

OpenClaw(前身 Clawdbot / Moltbot)是一个强大的本地 AI 代理框架,可以连接 Telegram、WhatsApp 等通讯软件,让你用手机直接调用本地大模型做事(写程序、控制电脑、搜索文件……等)。

搭配 Ollama 可以完全离线、免费、无 API 费用。

两种最推荐的安装方式(选一种即可)

方法 1:最简单(官方推荐,几乎一键完成)

适用: Mac、Linux、Windows(WSL)

-

先安装 Ollama(如果还没装)

- 官网:

- 下载安装后,终端执行(建议用 128k+ 上下文的强模型):

-

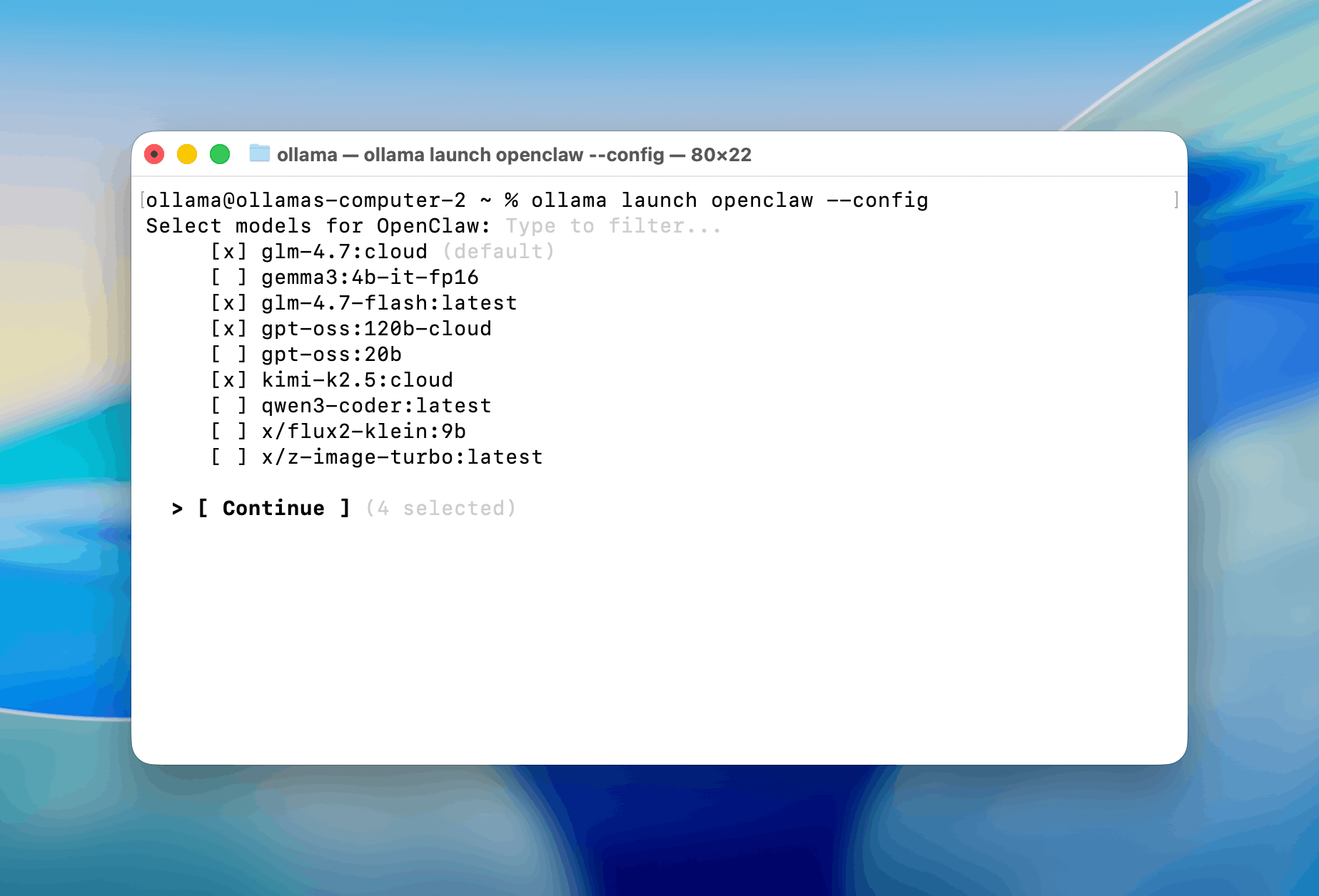

直接用 ollama launch 一键安装并启动 OpenClaw

这条指令会:

- 自动安装最新 OpenClaw

- 启动 onboarding 向导

- 自动选择 Ollama 作为后端

- 让你选模型(刚刚 pull 的那个)

- 设置 Telegram / WhatsApp 等通道(可先跳过)

完成后它会自动在后台运行 gateway(默认端口 18789)

-

设置完成后,Telegram bot 就能用了

- 如果想用 Telegram,onboarding 时选 Telegram → 照指示创建 bot 拿 token 贴上即可。

方法 2:手动安装(适合想自己管控的人)

-

安装 Node.js(建议 v22+)

-

一键安装 OpenClaw(官方最新推荐)

Mac/Linux:

Windows (PowerShell):

-

执行 onboarding

-

设置 Ollama 为后端

- 在向导里选 Quick Start → 跳过云端 → 选 Ollama。

- 或者手动编辑配置文件(

~/.openclaw/openclaw.json或类似位置):

-

启动

常见问题快速解决

-

模型没工具调用能力?

- 换 qwen2.5-coder、qwen3、deepseek-r1、llama3.3 等支持 function calling 的模型

- 至少建议 14B 以上,8B 很容易工具乱叫或忘记上下文

-

速度太慢?

- 用较小的模型先玩(qwen2.5-coder:14b、32b)

- 或租 RunPod / Vast.ai 的 GPU pod 跑 Ollama(很多中文教程)

-

想用中文最强?

- 目前(2026 年 2 月)推荐顺序:

qwen3 系列>deepseek-r1>llama3.3-Chinese

- 目前(2026 年 2 月)推荐顺序:

-

Telegram 收不到回应?

- 确认 OpenClaw 正在运行(看终端有没有 log)

- 确认 Ollama 也在运行(

ollama ps) - 重跑

ollama launch openclaw重新设置一次

基本上用 ollama launch openclaw 是目前最省事的做法,大多数人 5-10 分钟就能跑起来。