OpenClaw + Ollama ローカルセットアップガイド (2026年)

Claw

OpenClaw(旧称 Clawdbot / Moltbot)は、TelegramやWhatsAppのようなメッセージングアプリを接続し、スマートフォンから直接ローカルの大規模言語モデル(LLM)を呼び出してタスク(コーディング、コンピュータの制御、ファイルの検索など)を実行できる強力なローカルAIエージェントフレームワークです。

これを Ollama と組み合わせることで、完全にオフラインで、無料で、APIコストが一切かからない環境を構築できます。

2つの推奨インストール方法

方法 1: 最も簡単な方法(公式推奨)

対象: Mac、Linux、Windows (WSL)

-

Ollamaのインストール(まだインストールしていない場合)

- 公式サイト:

- ダウンロードしてインストールした後、ターミナルで以下を実行します(128k以上のコンテキストを持つモデルを推奨):

-

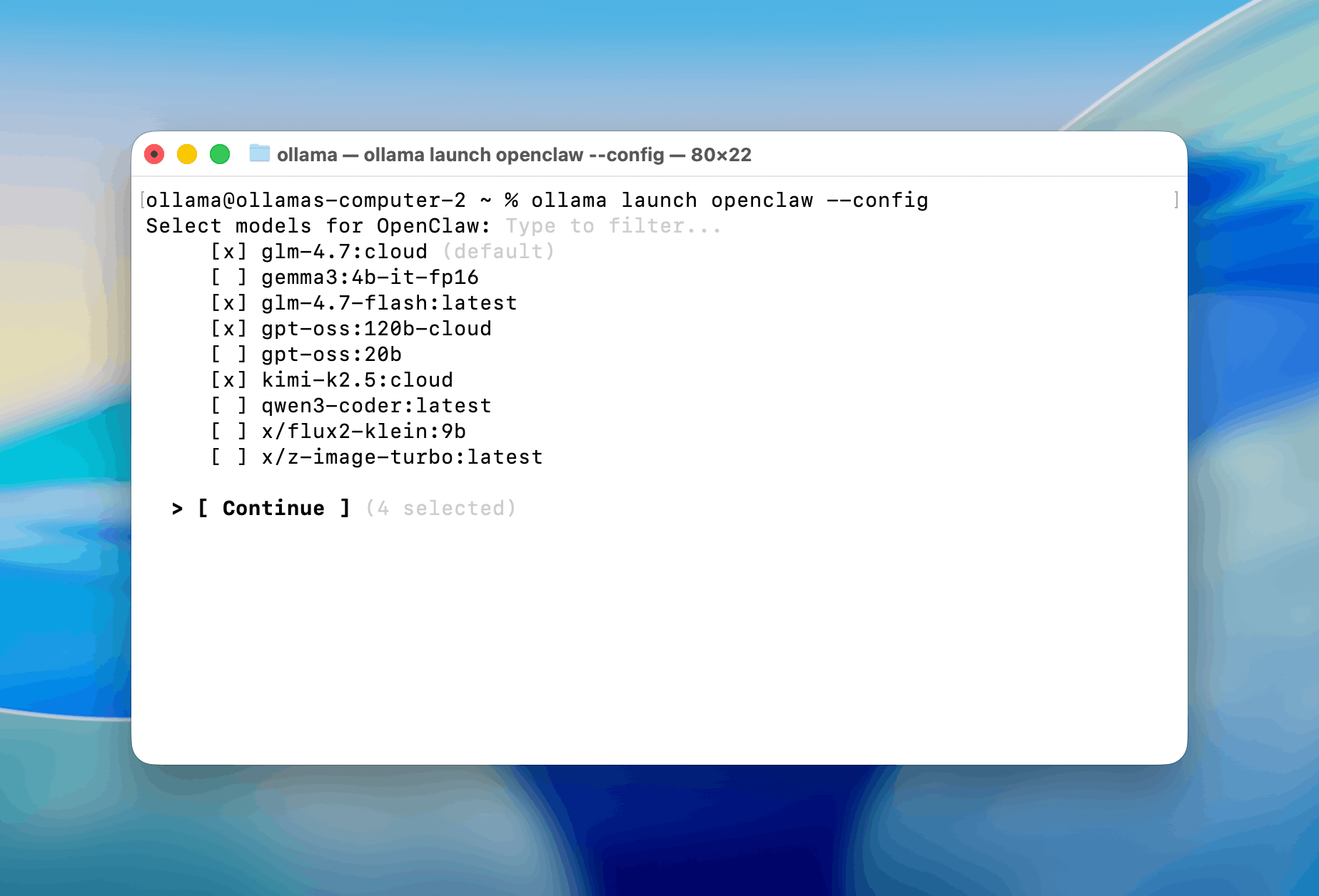

ollama launchでOpenClawを直接起動このコマンドにより以下の処理が行われます:

- 最新のOpenClawを自動的にインストール

- オンボーディングウィザードを開始

- バックエンドとしてOllamaを自動選択

- モデルの選択(先ほどpullしたモデル)

- Telegram / WhatsApp チャンネルの設定(最初はスキップ可能)

完了すると、バックグラウンドでゲートウェイが自動的に実行されます(デフォルトポート 18789)。

-

Telegram経由での使用開始

- オンボーディング中にTelegramを選択した場合は、指示に従ってボットを作成し、トークンを貼り付けてください。これでボットの準備は完了です!

方法 2: 手動インストール(高度な制御向け)

-

Node.jsのインストール(v22以上を推奨)

-

ワンクリックでOpenClawをインストール

Mac/Linux:

Windows (PowerShell):

-

オンボーディングの実行

-

Ollamaバックエンドの設定

- ウィザードで Quick Start -> スキップしてクラウド設定をオフにする -> Ollama を選択します。

- または、設定ファイル(

~/.openclaw/openclaw.json)を手動で編集します:

-

OpenClawの起動

トラブルシューティング(FAQ)

-

モデルにツール呼び出しの能力がない?

- 関数呼び出し(function calling)を適切にサポートするモデルに切り替えてください。例:

qwen2.5-coder,qwen3,deepseek-r1,llama3.3。 - 少なくとも14B以上のモデルを推奨します。8Bモデルだとツール呼び出しで幻覚(ハルシネーション)を起こしたり、コンテキストを忘れたりする可能性があります。

- 関数呼び出し(function calling)を適切にサポートするモデルに切り替えてください。例:

-

動作が遅すぎる?

- より小さなモデル(例:

qwen2.5-coder:14bや32b)を試してください。 - または、RunPodやVast.aiなどでGPUインスタンスをレンタルしてOllamaを実行してください。

- より小さなモデル(例:

-

日本語/中国語に最適なモデルは?

- 現在(2026年2月)の推奨:

qwen3 シリーズ>deepseek-r1>llama3.3。

- 現在(2026年2月)の推奨:

-

Telegramで返信がない?

- OpenClawが実行されているか確認してください(ターミナルのログを確認)。

- Ollamaが実行されているか確認してください(

ollama ps)。 ollama launch openclawを再実行して設定をやり直してください。

基本的には、現時点では ollama launch openclaw が最も手間のかからない方法です。ほとんどの人が5〜10分で設定を完了し、稼働させることができます。